Dans une nouvelle parue le 29 septembre sur le site Novetic.fr, il était annoncé que les GAFAM (avec une petite variante cette fois-ci, IBM remplaçant Apple dans l’acronyme) se préoccupaient de la façon dont les applications d’intelligence artificielle (IA) étaient développées. Sur leur initiative, une organisation sera créée pour encadrer les développements des IA, en partenariat avec des chercheurs de la société civile. Je vous propose de reprendre cet article ici et de tenter de le décrypter.

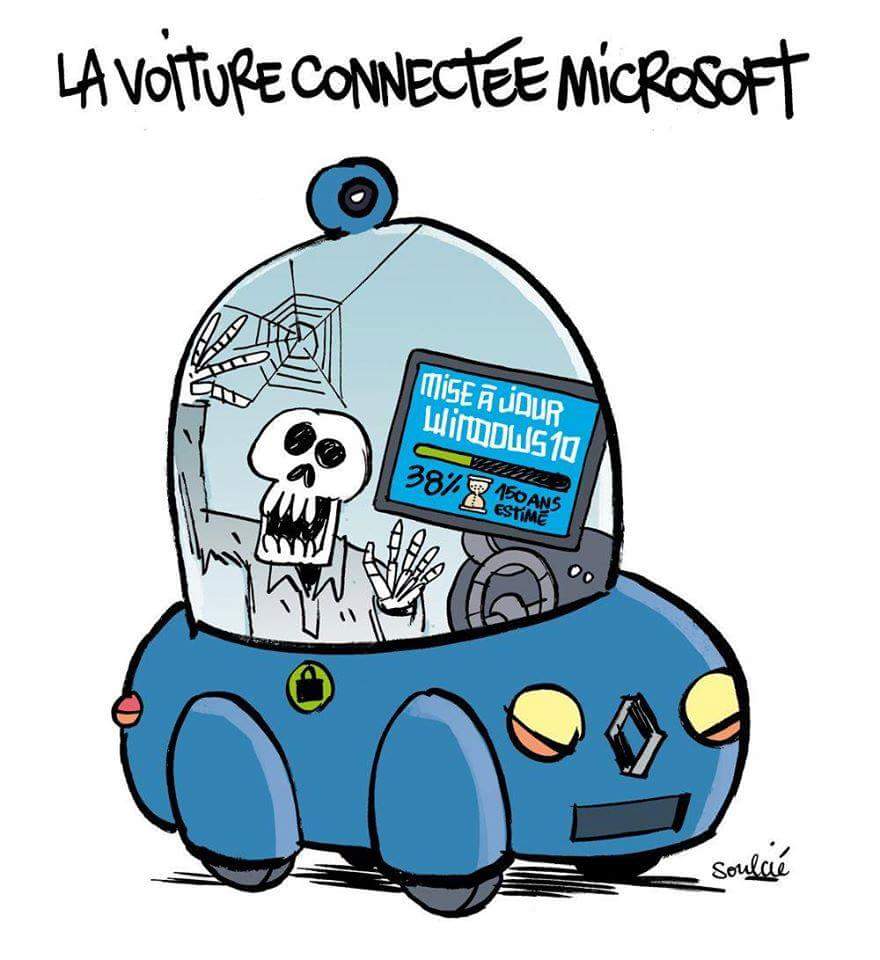

Je ne peux pas m’empêcher d’illustrer ce thème par un dessin de presse quelque peu insolent et bien tourné.

* Le terme « leadership » est utilisé ici volontairement en anglais. D’une part, il n’existe pas réellement une traduction exacte en français et d’autre part, le mot renforce la prédominance anglo-saxonne des GAFAM.

* Le terme « leadership » est utilisé ici volontairement en anglais. D’une part, il n’existe pas réellement une traduction exacte en français et d’autre part, le mot renforce la prédominance anglo-saxonne des GAFAM.

Intelligence artificielle : Microsoft, Google, IBM, Amazon et Facebook définissent de « bonnes pratiques »

Face au développement rapide de l’intelligence artificielle (IA), plusieurs géants américains du web ont officialisé mercredi 28 septembre un partenariat portant sur de « bonnes pratiques » éthiques sur ce thème.

Un partenariat concrétisé par la création d’une organisation – dont le bureau sera constitué pour moitié de chercheurs et de membres de la société civile, et pour l’autre moitié de représentants de ces firmes – qui aura plusieurs missions :

- Mener des recherches, qui seront publiques, sur l’intelligence artificielle

- Effectuer des recommandations de bonnes pratiques

- Sensibiliser le grand public et les décideurs politiques à la question de l’IA

Cette initiative vise à « protéger la vie privée et la sécurité des individus« , et « s’oppose au développement et à l’usage de technologies d’IA qui violeraient les conventions internationales ou les droits humains« .

Ces dernières années, les progrès de l’IA ont été fulgurants. La méthode du « Deep Learning » permet désormais à des ordinateurs de reconnaître des voix, des images et de progresser dans la compréhension du langage. Des progrès qui inquiètent des personnalités du monde scientifique, à l’instar de Stephen Hawking. L’astrophysicien britannique affirme que « l’IA pourrait mettre fin à l’humanité« .

Santé et transport sont des secteurs particulièrement visés par les entreprises impliquées dans l’intelligence artificielle.

L’IA représente-t-elle un danger pour nos sociétés ?

Il n’est pas question ici de s’opposer frontalement au développement des IA. C’est en effet une tendance lourde qu’il serait bien difficile de freiner, sans compter que ces avancées technologiques pourraient effectivement résoudre certains de nos problèmes. Nous nous penchons ici plus sur les acteurs qui promeuvent un développement rapide des IA ainsi que sur leurs intentions (buts ou objectifs cachés).

A la premier lecture de cet article, on pourrait se dire que les GAFAM agissent de manière respectueuse de la population en prenant en considération nos peurs sous-jacentes au développement massif des IA. Il faut ainsi un contrôle de la société civile et une compatibilité avec les conventions internationales et les droits humains. C’est très bien. Mais peut-on en rester là ?

Les IA vont représenter un sujet de société majeur ces prochaines années. Leur but est multiple, mais en caricaturant, on se rend compte que les IA seront développées pour remplir les buts suivants :

- L’automatisation de tâches réalisées par les humains en améliorant la fiabilité et la rapidité d’exécution.

> Quelles influences sur le marché de l’emploi ? - L’aide à la prise de décisions, voire la prise de décisions autonomisée par l’IA.

> Quelles influences sur la responsabilité juridique des IA face aux êtres humains ? - La gestion d’une quantité toujours plus grande d’informations non-structurées et l’anticipation de tendances ou d’événements.

> Quelles influences sur la marchandisation de nos informations personnelles et les incitations toujours plus virulentes au consumérisme ?

De grandes questions éthiques vont immanquablement se poser. Nous nous trouvons dans une période étonnante dans laquelle la fiction des années 50-70 rejoint la réalité d’aujourd’hui. Les IA vont assurément chambouler nos vies, notre travail ainsi que les équilibres dans la société.

Face à un thème aussi brûlant, peut-on laisser le leadership aux GAFAM, même s’ils nous assurent prendre les dispositions nécessaires pour que leur sujet de prédilection soit bien encadré, par des chercheurs indépendants et une gouvernance transparente ? Nous nous trouvons devant une problématique similaire, bien que plus sensible, lorsque les cigarettiers des années 80-90 engageaient des scientifiques, soit-disant indépendants, pour prouver que le tabac était totalement inoffensif pour la santé des fumeurs. Autre exemple très actuel : des entreprises actives dans l’énergie fossile financent des think-tanks ouvertement climato-sceptiques.

Je fais peut-être un procès d’intention. Mais le fait est que l’initiative ne vient pas de l’État ou d’organismes publics, mais des promoteurs eux-mêmes. On se doit donc de rester vigilent.

Une des conditions sine qua non pour garantir un développement transparent des IA est l’adoption de licences libres. En effet, l’accès au code source est primordial pour permettre la vérification citoyenne que ces IA ne transgressent pas des règles éthiques fondamentales. Mais il s’agit d’une condition parmi d’autres tout aussi importantes. Le développement des IA est une chose. Le développement du cadre régissant ces IA et les changements de sociétés induits, en est une autre. L’inaction du public laisse le champ libre aux GAFAM pour établir les règles du jeu qu’ils souhaitent et c’est regrettable. Nous devons renforcer la société civile pour contrebalancer ces déséquilibres de pouvoir.

Les CHATONS au service de la société

Comme nous l’avons vu dans des articles précédents sur ce blog, l’initiative des CHATONS, promue par l’association française Framasoft, vise justement à relocaliser les services informatiques de manière transparente et éthique.

Le 1er octobre 2016 a eu lieu une rencontre à l’Université de Genève, appelée Léman Innovation Numérique (LIN). A cette occasion, la coopérative itopie, en collaboration avec ll-dd.ch et Clowder, a proposé une conférence présentant les risques induits par les GAFAM sur la société ainsi qu’une réponse possible, certes minime en comparaison : CHATON-Léman.